- 欢迎使用千万蜘蛛池,网站外链优化,蜘蛛池引蜘蛛快速提高网站收录,收藏快捷键 CTRL + D

OpenAI与Meta合作的AI工具存在性别歧视内容:联合国教科文组织发声

AI算法存在性别歧视现象,联合国教科文组织发布研究报告

为什么AI算法存在性别歧视?

研究发现,被业界称为大型语言模型(LLMs)的算法表现出“对女性的明确偏见”。这些程序生成的文本将女性的名字与诸如“家庭”、“家庭”或“孩子”等词语联系在一起,而将男性的名字与“商业”、“薪水”或“职业”等词汇联系在一起。女性在这些文本中主要被描绘为妓女、厨师或家务助手,而男性则被描绘为担任教师、律师和医生等高地位职务。

怎样避免AI算法性别偏见?

尽管GPT-3.5相较于另外两个模型更少存在偏见,但与其闭源模型不同,研究作者赞扬Llama2和GPT-2是开源的,允许对这些问题进行仔细审查。

AI应用是否存在性别偏见影响社会认知?

联合国教科文组织的数字政策专家Leona Verdadero表示:“AI公司实际上并没有为所有用户提供服务。”教科文组织总干事Audrey Azoulay指出,由于公众日益在日常生活中使用AI工具,因此有必要对这些应用程序展现性别偏见的问题提出关切,因为它们有潜力在微妙中改变人们的看法。

图源备注:图片由AI生成,图片授权服务商Midjourney

这一发现引发了对AI伦理和性别平等的深刻反思,强调了AI技术对社会认知和公平性的潜在影响。联合国教科文组织的研究报告成为引发对AI应用程序性别偏见问题的关注的一个关键时刻。为了实现道德AI的应用和促进性别平等,AI企业和政府都需要采取行动,雇佣更多女性员工和少数族裔,并制定相关法规。

阅读完这篇文章后,我们应该思考如何在AI技术发展中解决性别偏见的问题,以确保AI工具服务于所有人群,不会对社会产生负面影响。请留下您宝贵的观点和评论,同时也欢迎您关注、点赞,感谢您的阅读。

网络推广最新文章

- AI技术日报:GPT4强敌Inflection-2.5模型发布 | Midjourney计划推出中国版APP

- 值得买改版:AI功能大量应用,什么值得买APP焕然一新

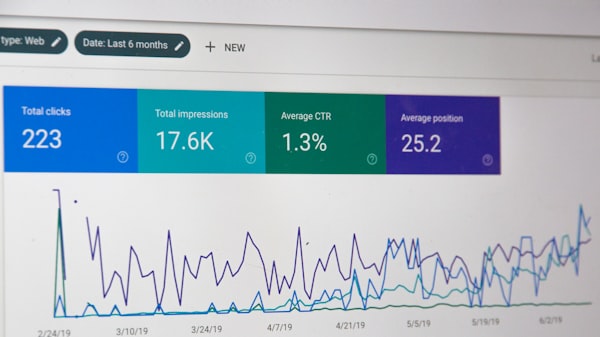

- SEO优化网站:揭示AI搜索引擎可见性提升的研究

- BlabAway官网体验入口:最新AI博客SEO软件工具在线使用地址

- 哪吒汽车交付量创新高 累计交付近40万台车辆

- 英伟达市值与苹果相差不足3000亿美元:黄仁勋靠AI赚大

- Inflection-2.5官网体验入口 | 人工智能个人AI对话聊天模型免费使用地址

- 人工智能在SEO内容创作领域的应用案例分析:LinkedIn、CNET和The Verge等5个真实网站案例

- OK

- GEO是地理信息系统的缩写,指地理空间信息的整体系统。与SEO(搜索引擎优化)相比,GEO侧重于地理位置数据和地理信息的展示与分析,而SEO则是针对网站在搜索引擎中的排名和可见性进行优化的一系列技术和

)

)

)

)

)

)